In der Statistik und Wahrscheinlichkeitstheorie bedeutet Korrelation, wie eng zwei Datensätze miteinander verbunden sind.

Korrelation bedeutet nicht immer, dass das eine das andere verursacht. Es ist sehr wohl möglich, dass ein dritter Faktor beteiligt ist oder dass die Beziehung zufällig ist.

Die Korrelation hat normalerweise eine von zwei Richtungen. Diese sind positiv oder negativ. Wenn sie positiv ist, dann gehen die beiden Sätze zusammen nach oben. Wenn sie negativ ist, dann geht die eine nach oben, während die andere nach unten geht.

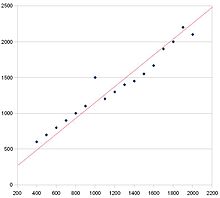

Viele verschiedene Korrelationsmessungen werden für verschiedene Situationen verwendet. Auf einem Streudiagramm wird beispielsweise eine Linie der besten Anpassung gezeichnet, um die Richtung der Korrelation zu zeigen.

Arten von Korrelation

- Positive Korrelation: Wenn größere Werte in Datensatz A tendenziell mit größeren Werten in Datensatz B einher (z. B. Körpergröße und Gewicht).

- Negative Korrelation: Wenn größere Werte in A mit kleineren Werten in B verbunden sind (z. B. Übungszeit und Fehleranzahl bei bestimmten Aufgaben).

- Keine Korrelation (Nullkorrelation): Es gibt keinen erkennbaren Zusammenhang zwischen den Variablen.

- Lineare vs. nichtlineare Korrelation: Eine Beziehung kann streng linear (durch eine Gerade beschreibbar) oder nichtlinear aber dennoch systematisch (z. B. quadratisch, exponentiell) sein.

Wichtige Maßzahlen

- Pearson-Korrelationskoeffizient (r): Misst die lineare Beziehung zwischen zwei intervall- oder verhältnisskalierten Variablen. Er liegt zwischen −1 und +1. Formel (in Worten): r = (Summe der Produkte der zentrierten Werte) geteilt durch das Produkt der Standardabweichungen beider Variablen.

Anschaulich: r = [Σ(xi − x̄)(yi − ȳ)] / [√(Σ(xi − x̄)²) · √(Σ(yi − ȳ)²)].

- Bestimmtheitsmaß (R²): Ist gleich r² (bei einfacher linearer Regression) und gibt den Anteil der Varianz in Y an, der durch X erklärt wird (in Prozent).

- Spearman-Rangkorrelation (ρ): Ein nichtparametrisches Maß zur Erfassung monotoner (nicht zwingend linearer) Zusammenhänge, geeignet für ordinale Daten oder wenn Annahmen von Pearson verletzt sind.

- Kendall-Tau: Ebenfalls ein robuster Rangkorrelationskoeffizient, der oft bei kleinen Stichproben verwendet wird.

- Phi, Punkt-Biserial, partielle Korrelation: Spezielle Maße für dichotome Variablen bzw. zur Kontrolle von Drittvariablen.

Interpretation von r

- Wertebereich: −1 (perfekte negative lineare Beziehung) bis +1 (perfekte positive lineare Beziehung). 0 bedeutet keine lineare Beziehung.

- Richtwerte (kontextabhängig und nicht streng verbindlich):

- |r| < 0,1: vernachlässigbar

- 0,1 ≤ |r| < 0,3: schwach

- 0,3 ≤ |r| < 0,5: moderat

- |r| ≥ 0,5: stark

- Achtung: Bei großen Stichproben können sehr kleine r-Werte statistisch signifikant, aber praktisch unbedeutend sein.

Grafische Darstellung

Vor der Interpretation sollte immer ein Streudiagramm betrachtet werden. Visualisierungen helfen, folgende Punkte zu erkennen:

- Lineares vs. nichtlineares Muster

- Ausreißer, die den Korrelationskoeffizienten stark beeinflussen können

- Cluster oder Untergruppen, die getrennt analysiert werden sollten

Korrelation ist nicht gleich Kausalität

Nur weil zwei Variablen korreliert sind, heißt das nicht, dass die eine die andere verursacht. Mögliche Erklärungen für eine gefundene Korrelation:

- Kausalität: X verursacht Y (muss durch experimentelle oder kausalanalytische Methoden belegt werden).

- Umgekehrte Kausalität: Y verursacht X.

- Konfundierung: Eine dritte Variable Z beeinflusst sowohl X als auch Y.

- Scheinkorrelation: Zufall oder gemeinsame Trends (z. B. Zeittrends) führen zu einer scheinbaren Verbindung.

Beispiele

- Positiv: Körpergröße und Gewicht (tendenziell höheres Gewicht bei größerer Körpergröße).

- Negativ: Anzahl der Lernfehler und Übungszeit (mehr Übung → weniger Fehler).

- Schein-/konfundierte Korrelation: Eisverkauf und Ertrinkungsfälle korrelieren positiv — Ursache ist die Temperatur (Sommer) als dritte Variable.

Praktische Hinweise für die Analyse

- Plotten Sie die Daten zuerst (Streudiagramm).

- Wählen Sie das passende Maß: Pearson für lineare Zusammenhänge, Spearman/Kendall für monotone bzw. ordinale Beziehungen.

- Überprüfen Sie Annahmen (Linearität, Normalverteilung der Residuen bei Pearson, Einfluss von Ausreißern).

- Bei Verdacht auf Drittvariablen partielle Korrelationen oder multivariate Modelle verwenden.

- Für kausale Aussagen sind kontrollierte Experimente, Längsschnittdaten oder kausalanalytische Methoden (Instrumentvariablen, Matching, DAG-Analyse) notwendig.

Zusammenfassend ist die Korrelation ein wichtiges Werkzeug, um Zusammenhänge in Daten zu erkennen und zu quantifizieren. Für belastbare Schlussfolgerungen über Ursachen sind jedoch zusätzliche Untersuchungen und eine sorgfältige methodische Absicherung erforderlich.