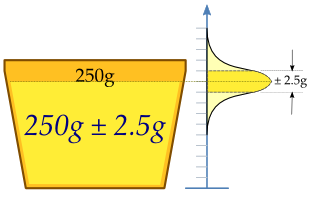

Eine Maschine füllt Becher mit Margarine. Für das Beispiel ist die Maschine so eingestellt, dass der Inhalt der Becher 250 g Margarine beträgt. Da die Maschine nicht jeden Becher mit genau 250 g füllen kann, weist der den einzelnen Bechern zugegebene Inhalt eine gewisse Variation auf und wird als Zufallsvariable X betrachtet. Diese Variation wird als normal um den gewünschten Mittelwert von 250 g verteilt angenommen, mit einer Standardabweichung von 2,5 g. Um festzustellen, ob die Maschine ausreichend kalibriert ist, wird eine Probe von n = 25 Bechern Margarine nach dem Zufallsprinzip ausgewählt und die Becher gewogen. Die Gewichte der Margarine sind X1, ..., X25, eine Zufallsstichprobe aus X.

Um einen Eindruck von der Erwartung μ zu bekommen, genügt es, eine Schätzung abzugeben. Der geeignete Schätzer ist der Stichprobenmittelwert:

μ ^ = X ¯ = 1 n ∑ i = 1 n X i . {\displaystyle {\hat {\mu }}={\bar {X}}={\frac {1}{n}}\sum _{i=1}^{n}X_{i}. }

Das Beispiel zeigt die tatsächlichen Gewichte x1, ...,x25, mit Mittelwert:

x ¯ = 1 25 ∑ i = 1 25 x i = 250,2 Gramm . {\darstellungsstil {\bar {x}}={\frac {1}{25}}\summe _{i=1}^{{25}x_{i}=250.2\,{\text{gramme}}. }

Wenn wir eine weitere Probe von 25 Bechern nehmen, könnten wir leicht Werte wie 250,4 oder 251,1 Gramm erwarten. Ein Probenmittelwert von 280 Gramm wäre jedoch extrem selten, wenn der mittlere Gehalt der Becher tatsächlich nahe bei 250 g liegt. Es gibt ein ganzes Intervall um den beobachteten Wert 250,2 des Stichprobenmittelwertes, innerhalb dessen, wenn der Mittelwert der Gesamtpopulation tatsächlich einen Wert in diesem Bereich annimmt, die beobachteten Daten nicht als besonders ungewöhnlich angesehen würden. Ein solches Intervall wird als Konfidenzintervall für den Parameter μ bezeichnet. Wie berechnen wir ein solches Intervall? Die Endpunkte des Intervalls müssen aus der Stichprobe berechnet werden, sie sind also Statistiken, Funktionen der Stichprobe X1, ..., X25 und damit Zufallsvariablen selbst.

In unserem Fall können wir die Endpunkte bestimmen, indem wir berücksichtigen, dass der Stichprobenmittelwert X aus einer normalverteilten Stichprobe ebenfalls normalverteilt ist, mit der gleichen Erwartung μ, aber mit dem Standardfehler μ/σ = 0,5 (Gramm). Durch Standardisierung erhalten wir eine Zufallsvariable

Z = X ¯ - μ σ / n = X ¯ - μ 0.5 {\displaystyle Z={\frac {{\bar {X}}-\mu }{\sigma /{\sqrt {n}}}}={\frac {{\bar {X}}-\mu }{0.5}}}

abhängig vom zu schätzenden Parameter μ, aber mit einer Standardnormalverteilung, die unabhängig vom Parameter μ ist. Daher ist es möglich, Zahlen -z und z, unabhängig von μ, zu finden, wobei Z mit einer Wahrscheinlichkeit von 1 dazwischen liegt - α, ein Mass dafür, wie sicher wir sein wollen. Wir nehmen 1 - α = 0.95. Das haben wir also:

P ( - z ≤ Z ≤ z ) = 1 - α = 0,95. {\Anzeigestil P(-z\leq Z\leq z)=1-\alpha =0.95.\,}

Die Zahl z ergibt sich aus der kumulativen Verteilungsfunktion:

Φ ( z ) = P ( Z ≤ z ) = 1 - α 2 = 0,975 , z = Φ - 1 ( Φ ( z ) ) = Φ - 1 ( 0,975 ) = 1.96 , {\Anzeigestil {\beginnt{ausgerichtet}\Phi (z)&=P(Z\leq z)=1-{\tfrac {\alpha }{2}}}=0.975,\\\[6pt]z&=\Phi ^{-1}(\Phi (z))=\Phi ^{-1}(0.975)=1.96,\endet{ausgerichtet}}} ![{\displaystyle {\begin{aligned}\Phi (z)&=P(Z\leq z)=1-{\tfrac {\alpha }{2}}=0.975,\\[6pt]z&=\Phi ^{-1}(\Phi (z))=\Phi ^{-1}(0.975)=1.96,\end{aligned}}}](https://www.alegsaonline.com/image/0e80e68d525d87d1b722d1150abda18cecb8f684.svg)

und wir bekommen:

0,95 = 1 - α = P ( - z ≤ Z ≤ ≤ z ) = P ( - 1,96 ≤ X ¯ - μ σ / n ≤ 1,96 ) = P ( X ¯ - 1,96 σ n ≤ μ ≤ ≤ X ¯ + 1,96 σ n ) = P ( X ¯ - 1,96 × 0,5 ≤ μ ≤ ≤ X ¯ + 1,96 × 0,5 ) = P ( X ¯ - 0,98 ≤ μ ≤ ≤ X ¯ + 0,98 ) . {\Anzeigestil {\begin{ausgerichtet}0.95&=1-\alpha =P(-z\leq Z\leq z)=P\left(-1.96\leq {\frac {{\bar {X}}-\mu }{\sigma /{\sqrt {n}}}}\leq 1.96\right)\\[6pt]&=P\left({\bar {X}}-1.96{\frac {\sigma }{\sqrt {n}}}\leq {\mu \leq {\bar {X}}+1.96{\frac {\sigma }{\sqrt {n}}}}right)\\\[6pt]&=P\left({\bar {X}}-1.96\mal 0.5\leq \mu \leq {\leq {\bar {X}}+1.96\mal 0,5\rechts)\\[6pt]&=P\links({\Balken {X}}-0,98\links \mu \leq {\mu \leq {\bar {X}}+0,98\rechts).\end{ausgerichtet}}} ![{\displaystyle {\begin{aligned}0.95&=1-\alpha =P(-z\leq Z\leq z)=P\left(-1.96\leq {\frac {{\bar {X}}-\mu }{\sigma /{\sqrt {n}}}}\leq 1.96\right)\\[6pt]&=P\left({\bar {X}}-1.96{\frac {\sigma }{\sqrt {n}}}\leq \mu \leq {\bar {X}}+1.96{\frac {\sigma }{\sqrt {n}}}\right)\\[6pt]&=P\left({\bar {X}}-1.96\times 0.5\leq \mu \leq {\bar {X}}+1.96\times 0.5\right)\\[6pt]&=P\left({\bar {X}}-0.98\leq \mu \leq {\bar {X}}+0.98\right).\end{aligned}}}](https://www.alegsaonline.com/image/2437ee6c7c0320fa30cec1de64773a6e7cc3a095.svg)

Dies könnte wie folgt interpretiert werden: Mit einer Wahrscheinlichkeit von 0,95 werden wir ein Konfidenzintervall finden, in dem wir den Parameter μ zwischen den stochastischen Endpunkten erfüllen

X ¯ - 0 . 98 {\Anzeigestil {\bar {X}}}-0{.}98\,}

und

X ¯ + 0.98. {\Anzeigestil {\bar {X}}+0.98.\,}

Dies bedeutet nicht, dass eine Wahrscheinlichkeit von 0,95 besteht, den Parameter μ im berechneten Intervall zu treffen. Jedes Mal, wenn die Messungen wiederholt werden, gibt es einen anderen Wert für den Mittelwert X der Probe. In 95% der Fälle wird μ zwischen den aus diesem Mittelwert berechneten Endpunkten liegen, in 5% der Fälle jedoch nicht. Das tatsächliche Konfidenzintervall wird durch Eingabe der gemessenen Gewichte in die Formel berechnet. Unser 0,95 Konfidenzintervall wird:

( x ¯ - 0,98 ; x ¯ + 0,98 ) = ( 250,2 - 0,98 ; 250,2 + 0,98 ) = ( 249,22 ; 251,18 ) . {\displaystyle ({\bar {x}}-0.98;{\bar {x}}+0.98)=(250.2-0.98;250.2+0.98)=(249.22;251.18).\,}

Da der gewünschte Wert 250 von μ innerhalb des resultierenden Konfidenzintervalls liegt, gibt es keinen Grund zur Annahme, dass die Maschine falsch kalibriert ist.

Das berechnete Intervall hat feste Endpunkte, wobei μ dazwischen liegen kann (oder auch nicht). Somit hat dieses Ereignis entweder eine Wahrscheinlichkeit von 0 oder 1. Das können wir nicht sagen: "mit Wahrscheinlichkeit (1 - α) liegt der Parameter μ im Konfidenzintervall". Wir wissen nur, dass durch Wiederholung in 100(1 - α) % der Fälle μ im berechneten Intervall liegt. In 100α % der Fälle ist dies jedoch nicht der Fall. Und leider wissen wir nicht, in welchem der Fälle dies geschieht. Deshalb sagen wir: "Bei Konfidenzniveau 100(1 - α) % liegt μ im Konfidenzintervall. "

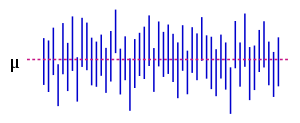

Die Abbildung auf der rechten Seite zeigt 50 Realisierungen eines Konfidenzintervalls für eine gegebene Population bedeuten μ. Wenn wir eine Realisation nach dem Zufallsprinzip auswählen, liegt die Wahrscheinlichkeit bei 95%, dass wir am Ende ein Intervall gewählt haben, das den Parameter enthält; es kann jedoch sein, dass wir Pech haben und das falsche gewählt haben. Wir werden es nie wissen; wir bleiben an unserem Intervall hängen.

![{\displaystyle {\begin{aligned}\Phi (z)&=P(Z\leq z)=1-{\tfrac {\alpha }{2}}=0.975,\\[6pt]z&=\Phi ^{-1}(\Phi (z))=\Phi ^{-1}(0.975)=1.96,\end{aligned}}}](https://www.alegsaonline.com/image/0e80e68d525d87d1b722d1150abda18cecb8f684.svg)

![{\displaystyle {\begin{aligned}0.95&=1-\alpha =P(-z\leq Z\leq z)=P\left(-1.96\leq {\frac {{\bar {X}}-\mu }{\sigma /{\sqrt {n}}}}\leq 1.96\right)\\[6pt]&=P\left({\bar {X}}-1.96{\frac {\sigma }{\sqrt {n}}}\leq \mu \leq {\bar {X}}+1.96{\frac {\sigma }{\sqrt {n}}}\right)\\[6pt]&=P\left({\bar {X}}-1.96\times 0.5\leq \mu \leq {\bar {X}}+1.96\times 0.5\right)\\[6pt]&=P\left({\bar {X}}-0.98\leq \mu \leq {\bar {X}}+0.98\right).\end{aligned}}}](https://www.alegsaonline.com/image/2437ee6c7c0320fa30cec1de64773a6e7cc3a095.svg)