Kalter Krieg

Siehe auch: Koreakrieg, Vietnamkrieg, Kuba-Krise, Weltraumrennen und Reagan-Ära

Nach dem Zweiten Weltkrieg waren die Sowjetunion und die Vereinigten Staaten die beiden mächtigsten Länder der Welt. Der Kalte Krieg war eine Zeit der Spannungen zwischen den beiden Ländern hinsichtlich ihrer Lebensweise. Die beiden Länder versuchten, andere Länder auf ihre Seite zu ziehen. Die Sowjetunion versuchte, die Länder dazu zu bringen, Kommunisten zu werden, und die Vereinigten Staaten versuchten, sie daran zu hindern, Kommunisten zu werden. Amerikanische und sowjetische Soldaten kämpften nie in Schlachten, aber sie kämpften indirekt im Koreakrieg (1950er Jahre) und im Vietnamkrieg (1950er - 1970er Jahre).

Der Koreakrieg dauerte nur wenige Jahre, führte aber dazu, dass sich seitdem amerikanische Soldaten in Korea aufhielten. Der Vietnamkrieg dauerte viel länger. Er begann mit einigen wenigen amerikanischen Truppen in Vietnam, aber in den 1960er Jahren wurden Tausende von Amerikanern nach Vietnam geschickt. Beide Kriege wurden zwischen einer kommunistischen Regierung im Norden, die von der Sowjetunion und dem kommunistischen China unterstützt wurde, und einer Regierung im Süden, die von den USA unterstützt wurde, ausgetragen. Über eine Viertelmillion Amerikaner starben oder wurden in Vietnam verwundet, was ein militärischer Fehlschlag war. Die USA und die Sowjetunion stritten darüber, wo sie Atomwaffen stationieren könnten. Eines dieser Argumente war die Kuba-Krise. Während der Kubakrise kamen sich die USA und die Sowjetunion sehr nahe, sich gegenseitig mit Atomwaffen anzugreifen.

Während des Kalten Krieges hatten die Vereinigten Staaten einen "Roten Schrecken", in dem die Regierung versuchte, Menschen zu finden, die sie für Kommunisten hielt. Das Repräsentantenhaus hatte eine Gruppe namens "Ausschuss für unamerikanische Aktivitäten", die sich damit befasste, und Joseph McCarthy leitete die Anhörungen im Senat. Der "Red Scare" führte dazu, dass Menschen ihre Arbeit verloren, ins Gefängnis kamen und sogar hingerichtet wurden. Viele Schauspieler und Autoren wurden auf schwarze Listen gesetzt, was bedeutete, dass sie keine Jobs in Filmen bekommen konnten oder keine Anerkennung für ihre Schriften erhielten.

Der Kalte Krieg begann mit einem Wettrüsten zwischen den Vereinigten Staaten und der Sowjetunion, um zu sehen, wer mehr und bessere Waffen haben könnte. Dies begann, nachdem die Sowjets das zweite Land waren, das eine Atombombe entwickelte. In den Vereinigten Staaten begann damit etwas, das als "militärisch-industrieller Komplex" bezeichnet wurde, was bedeutete, dass Wirtschaft und Regierung zusammenarbeiteten, um viel Geld für groß angelegte Waffenprojekte auszugeben. Wirtschaft und Regierung halfen sich gegenseitig, mehr Geld und mehr Macht zu bekommen. Teil dieses Komplexes war der so genannte Marshallplan, der Europa wiederaufbauen und gleichzeitig amerikanische Waren kaufen ließ. Der Komplex ermöglichte eine wachsende Mittelschicht, hielt aber auch den Kalten Krieg in Gang.

Neben dem Wettrüsten war ein weiterer Teil des Kalten Krieges das "Space Race". Es begann, als die Sowjets 1957 einen Satelliten namens Sputnik ins All schossen. Die Amerikaner waren besorgt, dass die Vereinigten Staaten hinter die Sowjetunion zurückfielen, und veranlassten ihre Schulen, sich mehr auf Mathematik und Naturwissenschaften zu konzentrieren. Innerhalb weniger Jahre hatten sowohl die Vereinigten Staaten als auch die Sowjetunion Satelliten, Tiere und Menschen in den Orbit geschickt. Im Jahr 1969 brachte die Apollo-11-Mission Neil Armstrong und Buzz Aldrin auf den Mond.

Die Außenpolitik der Vereinigten Staaten änderte sich in den 1970er Jahren, als die Vereinigten Staaten Vietnam verließen und Richard Nixon aufgrund eines politischen Skandals namens Watergate aus dem Amt schied. In den 1970er und 1980er Jahren verfolgten die Vereinigten Staaten eine Politik der "Entspannung" mit der Sowjetunion. Dies bedeutete, dass die beiden Länder Verträge unterzeichneten, um den Einsatz von Waffen zu stoppen. Unter Nixon und Reagan schickten die Vereinigten Staaten Truppen und Geld an viele lateinamerikanische Regierungen, um sie daran zu hindern, Kommunisten zu sein. Dies führte zu Gewalt in Lateinamerika. Um diese Zeit litt die Wirtschaft, weil die Vereinigten Staaten nicht mehr so viele Dinge herstellten wie früher und weil einige Länder im Nahen Osten den USA nicht so viel Öl gaben, wie sie wollten (dies wurde als "Ölembargo" bezeichnet). Der Nahe Osten wurde in der amerikanischen Außenpolitik sehr wichtig, nachdem 1979 mehrere Amerikaner im Iran entführt worden waren. In den 1980er Jahren verkauften Menschen in der US-Regierung Waffen an Menschen im Iran und gaben das Geld an "Kontra"-Soldaten in Nicaragua. Dies wurde die "Iran-Contra-Affäre" genannt. In den 1970er und 1980er Jahren normalisierten die USA ihre Beziehungen zu China. Der Kalte Krieg kam zu einem Ende, als die kommunistischen Regierungen in der Sowjetunion und anderen Ländern auseinanderfielen.

Häusliche und soziale Fragen

Die Vereinigten Staaten hatten wieder einmal Wohlstand. Millionen von Weißen zogen aus den Städten in die Vorstädte und in die südlichen und westlichen Staaten, die als "Sonnengürtel" bekannt sind. Sie kauften neue Autos und Fernsehgeräte. Die Geburtenrate stieg in den 1940er und 1950er Jahren, in dem, was als "Babyboom" bezeichnet wurde. Das "Weltraumzeitalter" inspirierte Kunst und Architektur im "Googie"-Stil. Es wurden viel mehr Menschen Teil der Mittelschicht, aber es gab immer noch viele Menschen, die arm waren.

Armut war am häufigsten unter Afroamerikanern anzutreffen. Die meisten lebten in armen Vierteln in Städten im Norden oder im Süden, wo sie mit Rassismus und "Jim Crow"-Segregation konfrontiert waren. Diese Bedingungen führten zur Bürgerrechtsbewegung der 1950er Jahre, die von Martin Luther King Jr. und anderen angeführt wurde. Im Jahr 1954 befand der Oberste Gerichtshof in der Rechtssache Brown gegen den Bildungsrat die Schultrennung für illegal, obwohl es noch einige Jahre dauern sollte, bis die Schultrennung beendet war. 1955 führte King einen Busboykott in Montgomery, Alabama, an. In den späten 1950er und 1960er Jahren erhielt King Hilfe von den Präsidenten John F. Kennedy, der erschossen wurde, und Lyndon B. Johnson. Im Jahr 1963 führte er einen Marsch nach Washington an, bei dem er Bürgerrechte forderte. Bald darauf verabschiedete der Kongress Gesetze, die die meisten Rassentrennungen illegal machten. Johnson verabschiedete auch ein Programm namens "Great Society", das armen Menschen und Minderheiten half.

Schwule und Lesben, die oft verfolgt worden waren, begannen ebenfalls, Rechte einzufordern, beginnend mit den Stonewall-Unruhen 1969. Chicanos, Ureinwohner Amerikas, alte Menschen, Verbraucher und Menschen mit Behinderungen kämpften ebenfalls für Rechte, ebenso wie Frauen. Obwohl Frauen während des Zweiten Weltkriegs Arbeit gehabt hatten, kehrten die meisten von ihnen nach dem Krieg in ihre Heimat zurück. Frauen mochten es nicht, dass sie oft Jobs hatten, die schlechter bezahlt wurden als die Männer oder dass ihnen weniger Möglichkeiten offen standen. Menschen wie Betty Freidan und Gloria Steinem gründeten Gruppen wie die National Organization for Women, um zu versuchen, diese Probleme zu lösen. NOW und andere Gruppen wollten einen Gleichberechtigungszusatz, der ihnen Gleichberechtigung in allen Bereichen garantieren würde. In den 1970er und 1980er Jahren wurden den Frauen viel mehr Arbeitsplätze und Möglichkeiten eröffnet. Es gab einige Frauen wie Phyllis Schlafly, die gegen Freidan und Steinem waren und als "Antifeministinnen" bekannt waren. Es lag zum Teil an den Antifeministinnen, dass die Gleichberechtigungsnovelle abgelehnt wurde, aber auch daran, dass Frauen in vielen Bereichen bereits Gleichstellung erlangt hatten und nicht in die Armee eingezogen werden wollten.

In den 1960er Jahren wurde die Gegenkultur geschaffen. Einige der Anhänger der Gegenkultur wurden Hippies genannt. Sie hatten lange Haare und lebten gemeinsam, rauchten Marihuana und praktizierten freie Liebe. Die Gegenkultur war zusammen mit College-Studenten die Gruppe, die am meisten gegen den Vietnamkrieg war. Sie waren auch die Gruppen, die sich neue Musik anhörten, die als Rock and Roll bekannt war.

1973 erließ der Oberste Gerichtshof eine Entscheidung namens Roe v. Wade, mit der viele Abtreibungen legalisiert wurden. Die vielen Änderungen führten zu einer Reaktion von Jerry Falwell und anderen Konservativen, die sich selbst die "Religiöse Rechte" und die "Moralische Mehrheit" nannten.

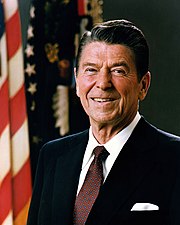

Reagan-Ära

Ronald Reagan wurde 1980 zum Präsidenten gewählt. Er besiegte den amtierenden Jimmy Carter, indem er 44 der 50 amerikanischen Bundesstaaten gewann. Während der Reagan-Ära sah sich das Land mit einer Inflation und einer schlechten Wirtschaft konfrontiert, und die amerikanische Außenpolitik war nicht so gut. Als Ronald Reagan Präsident wurde, unterzeichnete er den Economic Recovery Tax Act von 1981, der die Steuern für Unternehmen senkte, angeblich damit sie die überschüssigen Gewinne wieder in die Wirtschaft reinvestieren konnten. Während der Reagan-Präsidentschaft erweiterte er das amerikanische Militär und schuf damit mehr Arbeitsplätze, erhöhte aber auch das Defizit aufgrund von Ausgabenüberschreitungen. Während seiner ersten Amtszeit stieg die Wirtschaft von 4,5% auf 7,2%.

1984 siegte Reagan in einem großen Erdrutschsieg, als er 49 der 50 amerikanischen Bundesstaaten gewann. Während seiner zweiten Amtszeit konzentrierte sich Reagan auf die Beendigung des KaltenKrieges. Er hielt viele Treffen zwischen Margaret Thatcher, Papst Johannes Paul II. und dem sowjetischen Führer Michail Gorbatschow ab. Sie trafen sich erstmals 1985 auf dem Genfer Gipfel. Später entdeckten beide ihre Leidenschaft für die Beendigung des Krieges. Reagan traf sich viermal mit dem sowjetischen Führer Michail Gorbatschow, der 1985 an die Macht kam, und ihre Gipfelkonferenzen führten zur Unterzeichnung des Vertrags über die Mittelstreckenraketen.

Auch während seiner zweiten Amtszeit waren Reagans Invasion in Grenada und die Bombardierung Libyens in den USA beliebt, obwohl seine Unterstützung der Contras-Rebellen in der Kontroverse um die Iran-Contra-Affäre, die Reagans schlechten Führungsstil offenbarte, versickerte.

Seit seinem Ausscheiden aus dem Amt im Jahr 1989 wurde Reagan zu einem der beliebtesten Präsidenten der Vereinigten Staaten.

.svg.png)

,_by_John_Trumbull.jpg)

.webm.jpg)

.webm.jpg)